IMEで日本語と英語入力の切り替えができない状態になったので調べた。

実行環境は管理者として実行した powershell 7.1.3。

taskkill /im ctfmon.exe && ctfmon.exe

IMEで日本語と英語入力の切り替えができない状態になったので調べた。

実行環境は管理者として実行した powershell 7.1.3。

taskkill /im ctfmon.exe && ctfmon.exe

スクショを忘れたが Error code: 0x204 が出てリモートのWindowsにアクセスできない問題が発生した。

なお、同一ネットワークにおいて別のWindowsマシンから対象のリモートマシンにはリモートデスクトップ接続ができている。

ちなみに数ヶ月前には同一ネットワークにおいて今回問題が起きたマシンからリモートデスクトップができていた。

対応としてはMicrosoft Remote Desktopアプリを ctrl+q で終了した上で /Users/{USERNAME}/Library/Group Containers/UBF8T346G9.com.microsoft.rdc を削除する。

以下のQAを元に行った

debian busterのstableを運用しているマシンで iostat における %util についてNVMe SSDの場合のみ異常に数値が高かったのでとりあえず調査した。

特に原因の特定とかまではできておらず、雑に調べた内容を適当にメモしておくだけ。

最初に書いた通り iostat の %util の値が NVMe SSD に対してのみ高い。(2台のマシン、合計3つのメーカーが異なるNVMe SSDで再現を確認)

型番メモるのめんどいのでやる気が出たら追記する。

ちなみにHDDは特に異常に見える値は出ていなかった。

問題が発覚したマシンの iostat の結果が以下の通り。

Device r/s w/s rMB/s wMB/s rrqm/s wrqm/s %rrqm %wrqm r_await w_await aqu-sz rareq-sz wareq-sz svctm %util nvme0n1 21.29 33.76 0.27 1.11 1.09 3.00 4.88 8.15 0.73 0.27 0.87 13.13 33.81 15.38 84.65 sda 7.00 3.64 0.99 0.21 0.00 1.34 0.04 26.91 2.43 10.41 0.05 145.53 57.86 1.58 1.68

nvme0n1 の %util がやたら高い数値になっている。

Debian の stable と testing の最新を使って差異を確認した。

ちなみにいずれもクリーンインストールした状態で行った。

| - | - |

|---|---|

| マシン | Lenovo E495 Ryzen5 3500U |

| ディスク | WD BLUE SN550 |

| OS | Debian Buster (4.19.0-10), Debian Bullseye (5.7.0-2) |

二つのカーネルで大きな差が出た。

iostat に関してはバージョンの違いにより項目が変わっていたりするが %util を比較すると 4.19 の高さが際立つ。

/proc/diskstats の差も見ると time spent doing I/Os (ms) や weighted time spent doing I/Os (ms) の値が大きく違うことが分かる。

いずれのdiskstatsの値も起動後10分程度で取得した値である。

10分のうち7分以上もI/Oに費やされているとは思えない。

これらはカーネルの更新によって直ったとみるべきだろうか。

なお、/proc/diskstats の項目数が異なるのはカーネル5.5+より2項目増えたためである。 *1

時間とやる気ができればそのうちもうちょっと調べるかもしれない。

sysstat のバージョンをメモるのを忘れたが、たしか 12.0.3 だったと思う。

$ iostat -xdm Linux 4.19.0-10-amd64 (auburn) 08/09/2020 _x86_64_ (8 CPU) Device r/s w/s rMB/s wMB/s rrqm/s wrqm/s %rrqm %wrqm r_await w_await aqu-sz rareq-sz wareq-sz svctm %util nvme0n1 7.26 3.18 0.38 0.17 0.01 0.60 0.11 15.79 1.01 0.90 0.95 53.29 54.02 90.74 94.74 $ cat /proc/diskstats 259 0 nvme0n1 3744 4 399146 3734 1630 308 175074 1406 0 456044 459884 0 0 0 0 259 1 nvme0n1p1 1133 0 7370 2560 2 0 2 0 0 32 2484 0 0 0 0 259 2 nvme0n1p2 2375 4 378624 1151 1248 308 175072 1295 0 1392 2400 0 0 0 0 259 3 nvme0n1p3 153 0 9752 7 0 0 0 0 0 8 8 0 0 0 0

sysstat のバージョンは 12.3.3 だった。

$ iostat -xdm Linux 5.7.0-2-amd64 (auburn) 08/09/2020 _x86_64_ (8 CPU) Device r/s rMB/s rrqm/s %rrqm r_await rareq-sz w/s wMB/s wrqm/s %wrqm w_await wareq-sz d/s dMB/s drqm/s %drqm d_await dareq-sz f/s f_await aqu-sz %util nvme0n1 3.25 0.26 0.02 0.53 0.40 81.37 2.72 0.20 0.44 13.95 1.01 76.00 0.00 0.00 0.00 0.00 0.00 0.00 0.49 0.31 0.00 0.40 $ cat /proc/diskstats 259 0 nvme0n1 2610 14 424763 1036 2183 354 331801 2211 0 3240 3372 0 0 0 0 394 124 259 1 nvme0n1p1 107 0 6323 26 1 0 1 0 0 72 26 0 0 0 0 0 0 259 2 nvme0n1p2 2325 14 409240 999 1788 354 331800 2084 0 3168 3084 0 0 0 0 0 0 259 3 nvme0n1p3 114 0 6800 4 0 0 0 0 0 48 4 0 0 0 0 0 0

Debian の Bug Report #927184 に同じような症状の報告が上がっていた。

2020年7月28日に social.mikutter.hachune.net(以下s25t)においてサーバーにアクセスができない問題が発生しました。

復旧までに1週間弱かかりましたが、幸いデータの破損等はありませんでした。

2020/07/28 01:30 ~ 2020/08/01 19:40

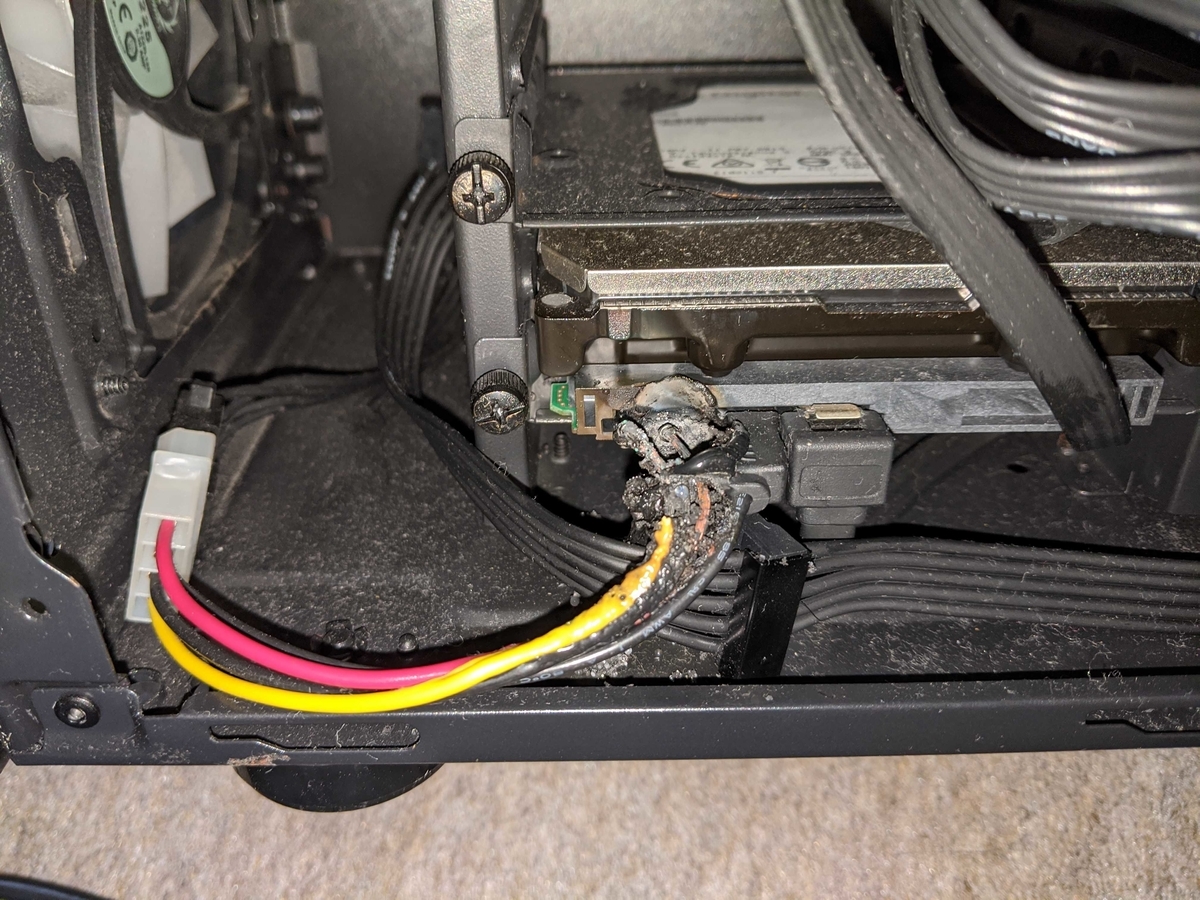

サーバー内のHDDに使用されていたペリフェラル電源−SATA電源変換ケーブルが焼けました。

ペリフェラル電源−SATA電源変換ケーブルが焼けたことが原因です。

上記変換ケーブルを利用していた理由としては、使用していたHDDが3.3V問題を抱えていたため、これを回避するために使用していました。

マストドンでアップロードされた画像等のメディアデータは、先日問題が発生したSSDではなく、HDD上に保存していました。

先月の問題発生によってSSDのバックアップは設定したが、HDDは画像だけだし、そのうちでいいかと思っていたところに、今回の事件が発生しました。

そのことによって、画像等のデータに全てアクセスできなくなるだけでも、事実上サービスを提供できなくなるということが判明しました。

SATA3.2規格のHDDで、3.3Vの電源入力があると動作しないHDDがあります。

今回問題となったHDDは、もともと外付けHDDとして販売されていたものをバラして内蔵HDDとして転用したもので、この問題によって動作しませんでした。

マシン構築当時は、ペリフェラル電源−SATA電源変換ケーブルでは3.3Vのピンがないことを利用して、この問題を回避していました。

| 月日 | 時分 | 事象 |

|---|---|---|

| 7/28 | 01:30 | ケーブルが焼ける |

| 01:50 | サーバー管理者がインシデントに気づく。この時点でサーバーの設置部屋と廊下がダイオキシンの匂いが充満していた。 | |

| 02:00 | 配線が焼けているのを発見した。この時点で電源は落ちていた。電源ケーブルをコンセントから抜く。 | |

| 07:00 | 起床して夢じゃないことを確認 | |

| 21:40 | HDDを @sushi に郵送 | |

| 7/29 | 19:40 | 交換用の電源ユニットを発注@sushi |

| 7/30 | 21:30 | @ahiruからHDDが届き初期診断 |

| 22:00 | 今回は焼けたHDDから直接データを取り出す方針とし、まずは焼損部分の除去を開始 | |

| 23:13 | 除去後には電源投入でき、HDDの全データをコピー開始 | |

| 7/31 | 18:30 | 電源ユニットが@ahiruの元に到着 |

| 20:20 | 全データのコピー完了を確認できた | |

| 20:45 | HDDを @ahiru に郵送 | |

| 8/1 | 09:55 | @sushi によって復旧されたHDDが到着 |

| 14:00 | 電源ユニットとHDDの交換作業開始 | |

| 17:40 | HDDの3.3Vのピンの除去作業 | |

| 19:40 | 復旧完了 | |

| 20:00 | フリージア をかけて復旧を祝う |

焼けた状態のHDDが到着し、まずは初期診断を実施

焼損部分は変換ケーブル側の12V付近とHDDの電源コネクタに限られたため、下記の道具を用意し焼けたコネクタの除去を行いました。

その後は用意していた同容量HDDにデータをすべて移し替えました。

前回の障害に引き続きs25tユーザーの皆様におかれましては、サーバの復旧を待っていただきありがとうございました。

Asciidocを使ってスライドを作ってみたくなった。

スライドを作るだけなら asciidoctor のリポジトリで管理されている asciidoctor.js と asciidoctor-revealjs を使うだけで済む。

npmパッケージを使用する場合は、公式の手順通りに上記パッケージをインストールしてコマンドを叩くだけだ。

今回はこれに加えてスライド作成時にライブリロードをしたかったので、そのあたりで試行錯誤したことを備忘録として書いておく。

なお、文章の体裁は崩壊してる。

まずはadocファイルの変更を検知してスライドのhtmlファイルに変換することを考えた。

ファイルの変更検知をどうするか適当に調べてみると、node.js標準の fs.watch とか、それをラップした Chokidar などが使えそうだった。

次にadocから生成されたhtmlのライブリロードについては、browser-sync というものを使ってみようとなった。

これによってファイル変更時のブラウザのライブリロードが実現できる。

つまり fs.watch とか Chokidar とかを別途入れて検知しなくても、browser-sync の監視対象のファイルをadocファイルにして、変更検知時にhtmlを生成させたうえでリロードできればいけるじゃんとなった。

ちなみに browser-sync の依存関係を追っていくと、chokidar を使っているようだった。

ドキュメントに chokidar 向けの設定に関して書かれていて気づいた。

browser-sync や asciidoctor-revealjs にはスクリプトで使用するためのインターフェースも用意されていたため、以下のようなスクリプトで実現できた。

browserSync.watch で ファイル名が .adoc で終わるファイルの変更を監視し、変更時は index.adoc をhtmlに変換したうえで browserSync.reload('index.html') でページのリロードを行っている。

このスクリプトの前提としては index.adoc がスライドのadocファイルのエントリポイントとなる。

ここをわざわざ変えたいことは自分はないだろうということでハードコードした。

後で気づいたけど、browser-sync はデフォだと change イベントしかリッスンしないので、if (event === 'change') ブロックいらないな。

スライド作成の環境整えて満足したのでスライド作成が進んでいない。

2020年6月22日に social.mikutter.hachune.net(以下s25t)においてサーバーにアクセスができない問題が発生しました。

復旧まで1週間弱かかりましたが、幸いなことにデータの破損等は見受けられませんでした。

なお復旧後確認したところ、過去30日間のSLAは80.5029%(thx @2bo)でした。

復旧後はユーザーより

などと厳しい追及を受けております。 精進いたします。

2020/06/22 02:10 ~ 2020/06/27 22:26

ディスクに対するあらゆるIOが不可能な状態になり、その結果サーバーに対する一切の接続ができない状況が発生しました。

ディスクイメージのバックアップ後に、サーバーが不安定になり始めた前後のログを確認しましたが、有用な情報は一切得られませんでした。

ディスクイメージ吸出しにあたり、ディスクの読み込みは問題ありませんでした。

更に吸出し後にホストに接続したところ問題なく起動しました。

起動後にストレージの状態をnvme-cliで確認しましたが、問題となるような情報は得られませんでした。

以上のことから原因不明と結論付けました。

| 月日 | 時分 | 事象 |

|---|---|---|

| 1/12 | ホストマシンをNUCから現在のマシンに移行。バックアップ設定は来週やることに。 | |

| 1月中旬 | このあたりからサーバ管理者が一ヶ月くらい寝込む。 | |

| 2月中旬 | 体調が回復。バックアップの設定変更のことは忘れている。 | |

| 6/22 | 02:10 | CPU,Load Averageの急激な上昇,Disk IOの急激な低下 |

| 02:30 | 監視系への通知が停止 | |

| 07:15 | 起床。体調がここ半年で最も悪い状態だった。 | |

| 07:29 | サーバー管理者が監視系の異常に気付き調査の開始 | |

| 08:52 | サーバーの電源を落とす。以降はまっとうな社会人として仕事を行っていた。 | |

| 12:00 | 午後休を取るも体調がよくなる傾向が皆無であったため、復旧は週末と決めた。 | |

| 18:00 | 最後のバックアップが1/12で停止していることが判明。この時点ではSSDの破損が強く疑われていたため、半年のデータ巻き戻りを前提に休養を進めることに。 | |

| 20:20 | 503ページの公開 | |

| 6/24 | 18:02 | memtest86+によるRAMメモリーチェックを開始 |

| 6/25 | 07:56 | memtest86+を2周した結果エラーなしを確認 |

| 6/26 | 17:37 | 作業用BGMとしてフリージアを購入 |

| 21:38 | フリージアをかけながら、翌日に行う復旧の手順書の作成と確認 | |

| 6/27 | 10:00 | 復旧作業の事前準備 |

| 14:00 | 復旧の開始 | |

| 17:51 | サーバーのテスト起動 | |

| 22:00頃 | フリージアをかけながらDNSの切り替え完了を待つ | |

| 22:26 | インスタンスの疎通確認 |

s25tユーザーの皆様に関しては、インスタンスの復旧を気長に待っていただきありがとうございました。

特に、復旧するにあたり相談させていただいたs25t管理者の方々には心より御礼申し上げます。

彼らがいたからこそ適切に復旧できたといっても過言ではありません。

docker-compose.yml のelasticsearchに関する記述のコメントイン

@@ -21,17 +21,17 @@ services: volumes: - ./redis:/data -# es: -# restart: always -# image: docker.elastic.co/elasticsearch/elasticsearch-oss:6.1.3 -# environment: -# - "ES_JAVA_OPTS=-Xms512m -Xmx512m" -# networks: -# - internal_network -# healthcheck: -# test: ["CMD-SHELL", "curl --silent --fail localhost:9200/_cluster/health || exit 1"] -# volumes: -# - ./elasticsearch:/usr/share/elasticsearch/data + es: + restart: always + image: docker.elastic.co/elasticsearch/elasticsearch-oss:6.1.3 + environment: + - "ES_JAVA_OPTS=-Xms512m -Xmx512m" + networks: + - internal_network + healthcheck: + test: ["CMD-SHELL", "curl --silent --fail localhost:9200/_cluster/health || exit 1"] + volumes: + - ./elasticsearch:/usr/share/elasticsearch/data web: build: . @@ -49,7 +49,7 @@ services: depends_on: - db - redis -# - es + - es volumes: - ./public/system:/mastodon/public/system

-#ES_ENABLED=true -#ES_HOST=es -#ES_PORT=9200 +ES_ENABLED=true +ES_HOST=es +ES_PORT=9200

1000:1000 にしないと起動時にアクセスできずエラーとなる。

$ mkdir -p elasticsearch $ chown -R 1000:1000 elasticsearch

vm.max_map_count を 26144 に上げる。- name: increase vm.max_map_count to maximum sysctl: name: vm.max_map_count value: 26144 state: present reload: yes

chewy:deploy を実行して完了

$ docker-compose up -d $ docker-compose run --rm web rails chewy:deploy